Introdução

Acredito que não é surpresa pra ninguém que atualmente existe uma nova corrida do ouro por poder computacional por parte das empresas de tecnologia e IA como Google, Meta, OpenAI, Anthropic, dentre outras. Essas empresas estão investindo bilhões de dólares para poder aumentar ou ter acesso a infraestrutura de GPUs, TPUs e, principalmente energética para alimentar esses servidores.

Essa fome por poder computacional é justificada pela máxima Bigger is Better, ou maior é melhor. Ou seja, quanto maior o modelo, com mais parâmetros, em tese, mais inteligente ele é. Por outro lado, mais poder computacional é necessário para treinar e operar esse modelo.

Nome do Modelo | Ano de lançamento | Número de parâmetros |

GPT-3 | 2020 | Estimado em 175 bilhões |

ChatGPT-4 | 2023 | Estimado em ~1.8 trilhões |

ChatGPT-4o Mini | 2024 | Estimado em ~8 bilhões |

GPT-5 | 2025 | Estimado em ~2-5 trilhões |

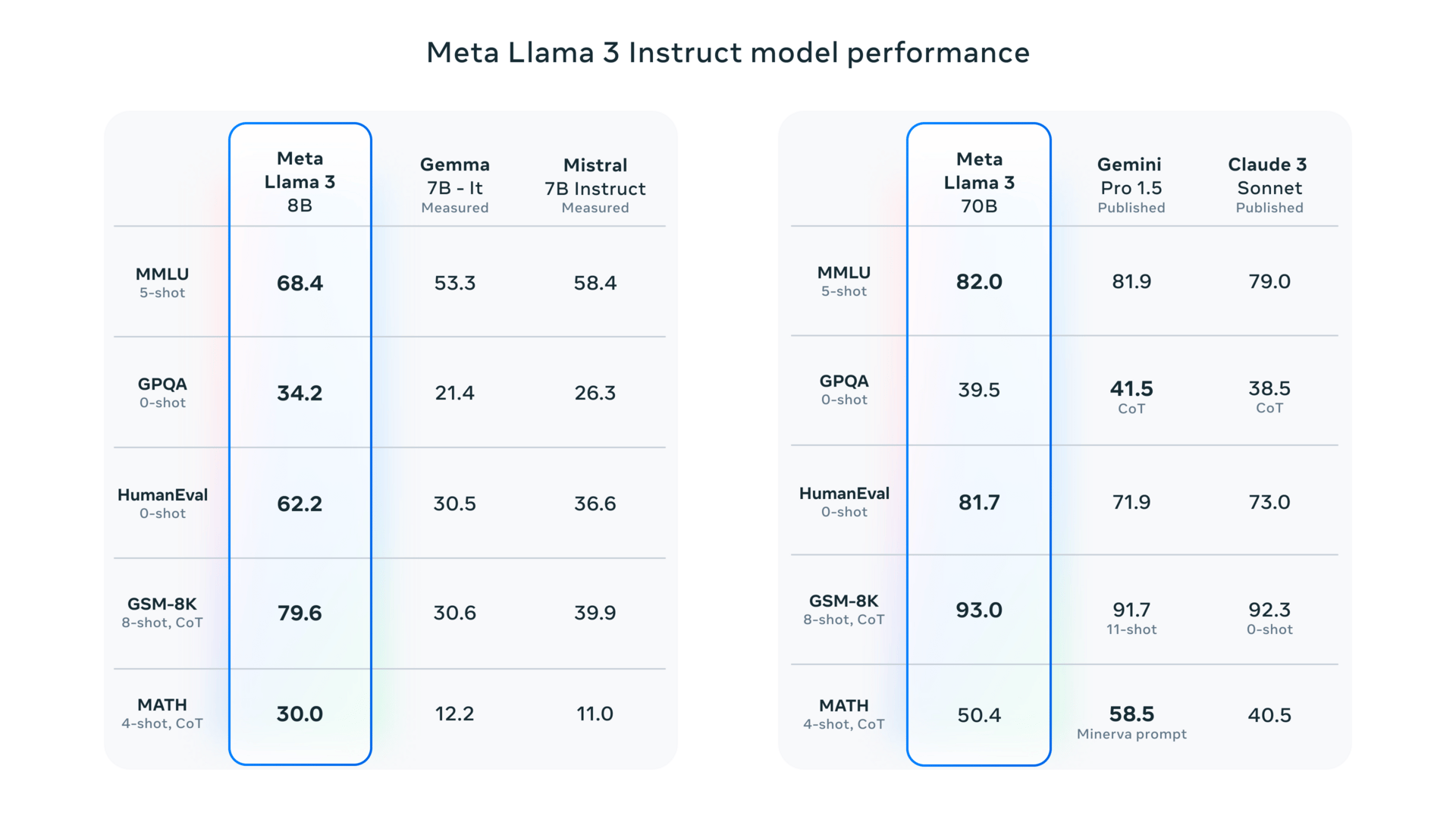

Comparação de performance entre LLaMa 8b vs 70B

Porém a oferta por GPUs de ponta, como a Nvidia H100, sofre uma grande escassez. De um lado, temos as big techs, startups, governos e centros de pesquisa competindo por esses chips. Do outro lado, a oferta é limitada por conta da complexa cadeia de suprimento de GPUs.

Bom, até o momento, realmente parece que quanto maior e com mais dados para treinamento tivermos, mais inteligente ficará o modelo. Mas, será que esse é um caminho sustável? Quando falamos de aplicações cada vez mais nichadas, utilizar um modelo menor e mais especializado não traria melhores resultados?